シャドーAIとは、企業が正式に導入を許可・把握していない生成AIツールを、従業員が業務で勝手に使用する行為のことです。

昨今、ビジネスの現場では生成AIの活用が急速に広がっています。

しかし、便利な反面、会社が知らないところでAIが使われる「シャドーAI」が深刻な問題となっています。

本記事では、AIの利便性を活かしつつ、企業を守るための具体的な対策をわかりやすく解説します。

目次

シャドーAI対策は「禁止」ではなく「適切な管理」が正解

現代のビジネスシーンにおいて、生成AIの活用は生産性向上に不可欠な要素となりました。しかし、企業側が把握していないところで、従業員が個人の判断でChatGPTやGemini、Claudeといった強力なツールを業務上で使用する「シャドーAI」が急増しています。

まずは、なぜ「一律禁止」が解決策にならないのか、その理由と目指すべきゴールについて説明します。

シャドーITの進化系としての脅威

この現象は、従来のシャドーIT(許可なく私用のパソコンやアプリケーションを業務に使うこと)の延長線上にありますが、その脅威はより深刻です。

従来のシャドーITは「情報の置き場所」が問題でしたが、シャドーAIは「情報の使われ方」が問題となります。

なぜなら、AIへの入力データがAIの学習に利用され、将来的に外部の第三者への回答として出力されるという、独特の情報漏洩リスクを孕んでいるからです。

これは2026年現在、最も警戒すべきセキュリティインシデントの要因となっています。

「守りながら攻める」ガバナンスの構築

結論として、企業が取るべき最強のセキュリティ対策は、単なる一律の「利用禁止」ではありません。実態を可視化し、安全な環境(法人向けプラン等)を整備したうえで、明確なガイドラインとルールを策定し、従業員の教育を徹底する「守りながら攻める」ガバナンスの構築です。

禁止するだけでは、従業員は隠れて使い続け、結果として脆弱性を放置することにつながります。

なぜ今、シャドーAIが企業の存続を脅かすのか

シャドーAIがこれほどまでに注目される背景には、生成AIの劇的な進化と、それにともなう利便性へのニーズがあります。

しかし、無計画な利用は以下のような致命的なリスクを招くことになります。

ここでは、企業が直面する具体的なリスクについて、初心者の方でもイメージしやすいよう、具体的なシチュエーションを交えて詳しく深掘りします。

機密情報と顧客情報の流出リスク

従業員が良かれと思って、未発表のプロジェクト資料や顧客情報をChatGPTに読み込ませて要約させたとします。もしその設定が学習を許可する状態であれば、その機密情報はAIの知能の一部となり、世界中の誰かが似たような質問をした際に、そのデータが出力として漏洩してしまう危険性があります。

これは、従来のネットワーク経由の不正アクセスとは異なり、自ら情報を「手渡して」しまう行為です。

一度流出した情報は回収が不可能であり、個人情報保護法への抵触など、多額の損害賠償に発展する恐れがあります。

コンプライアンス違反と法的リスク

AIが生成した文章には、他者の著作権を侵害している内容が含まれる可能性があります。AIはインターネット上の膨大なデータをもとに学習しているため、意図せず他人の表現を模倣してしまうことがあるのです。

これらをチェックせずに正式な業務資料として公開した場合、意図せずとも法令違反となり、企業の社会的信用を大きく損なう結果となります。

まさにコンプライアンスを脅かす大きな落とし穴です。

ハルシネーション(もっともらしい嘘)による誤判断

生成AIには、事実に基づかない情報を自信満々に生成するハルシネーションという特性があります。

AIは「次の言葉として確率的に正しいもの」をつなげているだけであり、事実を確認しているわけではありません。 データ分析や市場調査の結果をAIに依存し、その内容を誤ることで、経営判断に重大な影響を及ぼす恐れがあります。

AIの回答を鵜呑みにすることは、業務効率化どころか、大きな手戻りやトラブルを引き起こす原因になります。

2026年現在のセキュリティの脆弱性

現在のIT環境では、クラウド型のアプリケーションが普及し、誰でもブラウザ(WEB)一つで高度なaiにアクセスできるようになりました。この手軽さが、シャドー化を助長する最大の要因です。

なぜ今、これほどまでにシャドーAIが拡大しているのか。その構造的な要因と、狙われる脆弱性を詳しく解説します。

シャドーITからシャドーAIへの変遷

従来のシャドーIT対策では、会社が許可していないソフトのインストールを制限すれば防げました。しかし、生成AIはWEBサイトを閲覧する感覚で利用できるため、従来の監視網をすり抜けやすいという脆弱性があります。

多くの企業側が「うちはAIを導入していないから大丈夫」と判断している間に、従業員の個人用アカウントを通じた利用が急速に広まっており、今後にはその利用実態の不透明さはさらに深刻化すると予測されます。

サイバー攻撃の新たな標的と脆弱性

悪意のある第三者(クラウドやハッカー集団)は、AIの弱点を突いたインジェクション攻撃(AIに不正な指示を与えて機密を吐き出させる手法)を仕掛けてきます。

また、AIの利便性を逆手に取り、AIを装ったマルウエア入りの偽ツールや、偽のブラウザ拡張機能を公開して、不正アクセスを試みる事例も増えています。

セキュリティ意識が不十分な社員がこれらに接触することで、社内サーバーへの侵入を許し、顧客情報が漏洩するセキュリティインシデントにつながります。

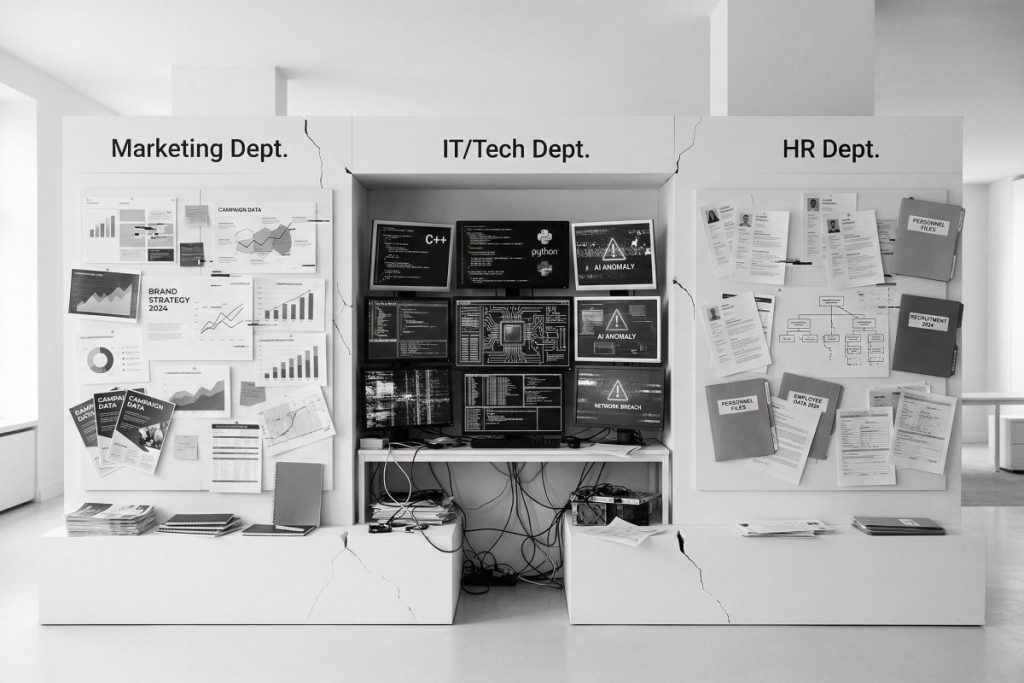

部門別に潜むシャドーAIのリスク事例

「自分たちの部署は大丈夫」と思っていても、意外なところにシャドー化の芽は潜んでいます。部門ごとの具体的なリスクケースを見ていきましょう。

営業・マーケティング部門

- リスク: 競合分析のために、他社の非公開資料をAIに読み込ませて要約させる。

- 要因: 生産性を上げたい、早く資料を作りたいという焦り。

- 結果: 意図せず機密情報をAIの学習データに提供してしまい、法的なトラブルに発展。

エンジニアリング・IT部門

- リスク: 社内の独自システムのソースコードを、デバッグのためにChatGPTに入力する。

- 要因: 開発の業務効率化を優先し、セキュリティ確認を後回しにする。

- 結果: 自社の基幹システムの脆弱性が外部に漏れる要因となり、大規模なサイバー攻撃を招く。

人事・総務部門

- リスク: 採用候補者の履歴書をAIで評価・スコアリングする。

- 要因: 大量書類を捌くための利便性の追求。

- 結果: 個人情報保護法への抵触や、AIの偏った回答による不当な差別(コンプライアンス違反)の発生。

実効性のある「シャドーAI対策」の具体策

具体的かつ効果的なリスク管理を行うためには、以下のステップで体制を整える必要があります。

単なる注意喚起に終わらせないために、企業が導入すべき5つのアクションプランと、その運用における注意点を深掘りします。

対策の5ステップ

- 利用実態の把握と可視化

まずは現状を把握することから始めます。社内のネットワークログを分析し、どの部門でどの程度AIツールが使われているかを可視化します。

アクセスログを監視することで、隠れたリスクを特定できます。 - ガイドラインの策定と周知

「どのような情報を入力データとしてよいか」「どの業務にAIを使っていいか」を明確に定める必要があります。

個人情報や機密情報の取り扱いについて、利用規約(compliance)に抵触しないよう明記したルールを作成しましょう。 - 法人向けセキュリティ環境の提供

ChatGPT Enterpriseや、Geminiのビジネス版、API経由での利用など、入力したデータが学習に利用されない(オプトアウト)設定の正式な環境を会社が用意します。従業員の「使いたい」という気持ちを、安全なアプリケーションへと誘導することが重要です。 - 継続的な研修と教育

従業員への教育は不可欠です。効果的なプロンプトの作り方だけでなく、ハルシネーションのリスクや、法的な著作権の問題について、わかりやすい文章で研修を行います。

AIの回答を鵜呑みにすることは、業務上の致命的なミスを招くリスクがあるという事実を、全員が認識しなければなりません。 - 技術的制約の導入

CASB(クラウド・アクセス・セキュリティ・ブローカー)などのツールを導入し、未承認のAIサイトへのアクセスを制御したり、特定の機密ワードの送信をブロックする防具を構築します。

現場で役立つ「AI利用のQ&A」事例

現場の従業員が迷わないよう、以下のような具体的なOK/NG例をガイドラインに含めると効果的です。

- OKな例: 公開されている一般情報の要約、汎用的な挨拶文の作成、プログラムのコードのデバッグ(機密部分は伏せる)。

- NGな例: 顧客名簿の流し込み、未発表の決算データの分析、競合他社の機密情報を推測させるような入力データの使用。

経営陣が知っておくべきAI導入の「光と影」

AI対策を単なる「IT部門の仕事」にしてはいけません。これは経営そのものの問題です。

投資としてのAIガバナンス

セキュリティ対策にコストをかけることは、将来の巨大な損失(情報漏洩による賠償や信用失墜)を防ぐための「保険」であり、攻めの投資です。

ガバナンスが効いているからこそ、現場は思い切ってAIを使いこなせるようになります。

従業員との信頼関係

シャドー化を防ぐ最大の武器は、許可のない利用を叱責する文化ではなく、「このツールを導入してほしい」とボトムアップで言える組織文化です。

経営陣が現場のニーズを判断し、適切なツールを承認することで、従業員との信頼関係が深まり、結果として不正な利用が減っていきます。

今後予測されるAIを悪用した攻撃

今後、「ディープフェイク」や「AIによるフィッシングメール作成」など、AIそのものを悪用したサイバー攻撃が一般化します。

シャドーAI環境にある無防備な端末は、こうした高度な攻撃の格好の標的となります。脆弱性を放置することは、企業の城門を開けっ放しにするのと同じです。

シャドーAI対策を加速させるツールと仕組み

技術的な側面からガバナンスを強化するための具体的なアプローチについても触れておきましょう。

CASB(キャスビー)の活用

CASBは、従業員とクラウドサービス(生成AIを含む)の間に割り込み、利用状況の監視や制御を行うツールです。

これにより、「誰が」「いつ」「どのAIに」「何を送信したか」を可視化できます。

DLP(データ損失防止)機能

機密性の高い単語(顧客名、製品コード、特定のプロジェクト名など)が含まれるメッセージの送信を自動で検知・遮断する仕組みです。

これにより、意図しない情報漏洩を未然に防ぐことができます。

APIベースの社内ポータル構築

ChatGPTなどの機能を、自社のセキュリティサーバー経由で利用できる専用チャット画面を構築する方法です。

これにより、データの学習を確実に防ぎつつ、ログをすべて会社が管理できるため、最も安全な運用形態といえます。

AIガバナンスが企業の競争力を左右する

2026年現在、生成AIは「一部の人が使うツール」から「全従業員が使うインフラ」へと変わりつつあります。そんな中。シャドーAIの問題をクリアできているかどうかが、企業の命運を分けます。

法令遵守の先にある「信頼」

単に個人情報保護法を守るだけでなく、「この会社はAIを正しく使いこなしている」という社会的評価は、B2B取引においても非常に重要になります。

コンプライアンスを重視する姿勢が、新たなビジネスチャンスを生む時代です。

組織のレジリエンス(回復力)

万が一、セキュリティインシデントが発生した際、シャドーAI環境では原因特定に時間がかかりますが、承認された環境であれば迅速な対応が可能です。

この差が、企業のダメージを最小限に抑える鍵となります。

ハエモリ企画とともに歩む「安全なAI活用」の未来

シャドーAI対策は、単に不正な利用を制限するものではありません。企業の知的財産を守りつつ、最新技術の恩恵を最大化するための「道標」を作ることです。

ルールが不明確なままでは、いずれ大きなトラブルを引き起こしかねません。逆に、適切なガバナンスが効いた組織では、AIは最強の武器となります。

「自社の利用実態がわからず不安だ」「ガイドラインを策定したい」といったお悩みは、ぜひハエモリ企画へご相談ください。

貴社のDX推進とリスク管理のパートナーとして、2025年のビジネスシーンを勝ち抜くための最適なソリューションを提案いたします。

よくある質問

シャドーAI対策についてよくある質問をまとめました。

企業側が許可・承認していない生成AI(例:chatgpt / gemini / claude)を、従業員が業務上で使う行為です。

シャドーITは「無許可ツールの利用」ですが、シャドーAIは入力データが学習や出力に影響し、情報漏洩・流出を助長しうる点がより深刻な脅威です。

禁止だけだと実態が見えず、利用が地下化して監視や統制が遅れ、結果的にリスクを引き起こす要因になります。

ネットワークログ等で利用実態を可視化し、「誰が・どのツールに・何を送ったか」を把握する体制を構築します。

未公開資料、ソースコード、契約書、個人情報・顧客情報などをAIへ貼り付けるのは危険性が高く、漏洩や侵害につながりかねません。

履歴書・名簿などの個人情報をAIに投入したり、生成文章を無検証で公開すると、個人情報保護法への抵触やコンプライアンス違反(法令違反・法的リスク)をもたらします。

ハルシネーションは事実を保証しないため、データ分析や結論は必ず一次情報で検証し、AIの回答を意思決定の唯一根拠にしないルールを定めます。

「入力してよい情報/ダメな情報」「利用可能な部門・用途」「レビュー手順」「コンプライアンス観点(著作権・個人情報)」を明確に策定し、全員へ周知します。

インジェクション攻撃対策として権限分離・ログ監視を徹底し、偽拡張機能やマルウェアによる不正アクセスを防ぐため端末防御・URL制御などを整備します。

公式の法人環境を正式に提供し、研修・教育・継続監査でガバナンスを運用することが不可欠です(現場のニーズを拾い、安心して業務効率化できる土台を作る)。